Очень часто требуется закрыть сайт от индексации, например при его разработке, чтобы ненужная информация не попала в индекс поисковых систем или по другим причинам. При этом есть множество способов, как это можно сделать, все их я и рассмотрю в этой статье.

Зачем сайт закрывают для индекса?

Есть несколько причин, которые заставляют SEO-специалистов и вебмастеров скрывать свои проекты от поисковых роботов. Зачастую к такой процедуре они прибегают в трех случаях:

- Когда только создали сайт и меняют на нем интерфейс, навигацию и прочие параметры, наполняют его различными материалами. Разумеется, веб-ресурс и контент, содержащийся на нем, будет не таким, каким бы вы хотели его видеть в конечном итоге. Естественно, пока сайт не доработан, разумно будет закрыть его от индексации Яндекса и Google, чтобы эти мусорные страницы не попадали в индекс. Не думайте, что если ваш ресурс только появился на свет и вы не отправили поисковикам ссылки для его индексации, то они его не заметят. Роботы помимо ссылок могут учитывать еще и ваши посещения через браузер.

- Иногда разработчикам требуется поставить вторую версию сайта, аналог основной на которой они тестируют доработки, эту версию с дубликатом сайта лучше тоже закрывать от индексации, чтобы она не смогла навредить основному проекту и не ввести поисковые системы в заблуждение.

- Закрыть часть ненужных страниц, которые генерирует движок сайта. Это не запрет индексации всего сайта, но возможно большой части его раздела.

Какие есть способы запрета индексации сайта?

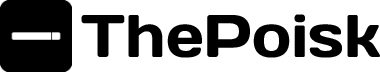

1. Закрытие индексации через WordPress

Если сайт создан на базе WordPress, это ваш вариант. Скрыть проект от ботов таким образом проще и быстрее всего:

- Перейдите в «Панель управления».

- Затем в «Настройки».

- А после – в «Чтение».

- Отыщите меню «Видимость для поисковиков».

- Возле строки «Рекомендовать поисковым роботам не индексировать сайт» поставьте галочку.

- Сохраните изменения.

Благодаря встроенной функции, движок автоматически изменит robots.txt, откорректировав правила и отключив тем самым индексацию ресурса.

На заметку. Следует отметить, что окончательное решение, включать сайт в индекс или нет, остается за поисковиками, и ниже можно увидеть это предупреждение. Как показывает практика, с Яндексом проблем не возникает, а вот Google может продолжить индексировать документы закрытые в robots.txt.

2. Посредством файла robots.txt

Если у вас нет возможности проделать эту операцию в WordPress или у вас стоит другой движок сайта, закрыть веб-сайт для поисковиков можно вручную через файл robots.txt.

Важно! Я уже упоминал об этом выше, что для поисковых машин данный файл несет лишь рекомендационный характер, и окончательное решение по индексированию остается за ними.

Создайте обычный текстовый документ в формате txt, и назовите его robots.

Затем скиньте его в корневую папку своего проекта, чтобы этот файл мог открываться по такому пути site.ru/robots.txt

Но сейчас он у вас пустой, поэтому в нем потребуется прописать соответствующие команды, которые позволят закрыть сайт от индексации полностью или только определенные его элементы. Рассмотрим все варианты, которые вам могут пригодиться.

Закрыть сайт полностью для всех поисковых систем

Пропишите в robots.txt команду:

User-agent: *

Disallow: /Это позволит запретить ботам всех поисковиков обрабатывать и вносить в базу данных всю информацию, находящуюся на вашем веб-ресурсе. Проверить документ robots.txt, как мы уже говорили, можно, введя в адресной строке браузера: Название__вашего_домена.ru/robots.txt.

Если вы все сделали правильно, то увидите все, что указано в файле. Но если, перейдя по указанному адресу, вам выдаст ошибку 404, то, скорее всего, вы разместили файл не в том месте.

Отдельную папку

Прописав эти параметры вы скроете все файлы, находящиеся в указанной папке.

User-agent: *

Disallow: /folder/Только в Яндексе

Закрыть сайт от индексации только для поисковой системы Яндекс.

User-agent: Yandex

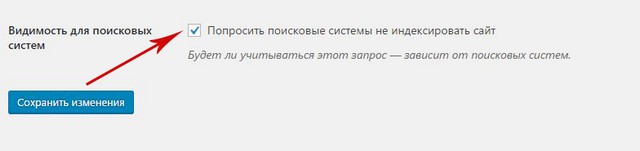

Disallow: /Чтобы перепроверить, получилось ли у вас закрыть свой сайт для Яндекса, добавьте его в Яндекс.Вебмастер, после чего зайдите в «Инструменты» и «Анализ robots.txt»

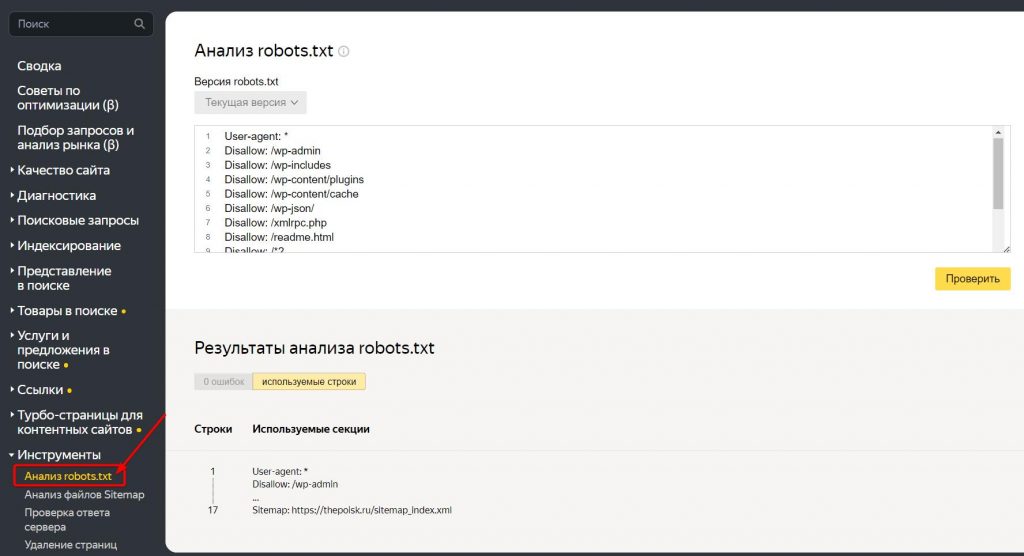

В поле для проверки URL вставьте несколько ссылок на страницы вашего ресурса, и нажмите «Проверить». Если они скрыты от ботов, напротив них в результатах вы увидите отмеченный результат красным цветом, который указывает, какая переменная закрывает эту страницу от индексации в robots.txt.

Только для Google

Закрыть весь сайт от индексации только для поисковой системы Google.

User-agent: Googlebot

Disallow: /Для других поисковиков

Все поисковики имеют собственных ботов с уникальными именами, чтобы вебмастера могли прописывать их в robots.txt и задавать для них команды.

Самые распространенные (кроме Яндекса и Google):

- Поисковик Yahoo. Имя робота – Slurp.

- Спутник. Имя робота – SputnikBot.

- Bing. Имя робота – MSNBot.

Список имен всех ботов вы с легкостью найдете в интернете.

Скрыть изображения

Чтобы поисковики не могли индексировать картинки, пропишите такие команды (будут зависеть от формата изображения):

User-Agent: *

Disallow: *.png

Disallow: *.jpg

Disallow: *.gifЗакрыть от индексации поддомен

Любой поддомен содержит собственный robots.txt. Как правило, он находится в корневой для поддомена папке. Откройте документ, и непосредственно там укажите:

User-agent: *

Disallow: /Если такого текстового документа в папке поддомена нет, создайте его самостоятельно.

3. С применением тега name=”robots”

Использование мета-тега robots – еще один способ, который поможет скрыть от роботов поисковых систем какую-либо страницу или полностью весь сайт.

Данный вариант является одним из самых приоритетных к исполнению для поисковиков. Для этого в любом месте внутри тегов <head> и </head>, нужно прописать код на той странице которую вы хотите закрыть от индексации:

<meta name=”robots” content=”noindex, nofollow”/>или

<meta name=”robots” content=”none”/>4. В настройках сервера

К этому варианту вебмастера прибегают в тому случае, когда роботы вообще никак не реагируют на действия, описанные выше.

Такое иногда случается, и тогда приходится решать проблему в настройках сервера посредством файла .htaccess. Откройте его и пропишите в нем такие команды:

SetEnvIfNoCase User-Agent "^Googlebot" search_bot

SetEnvIfNoCase User-Agent "^Yandex" search_bot

SetEnvIfNoCase User-Agent "^Yahoo" search_bot

SetEnvIfNoCase User-Agent "^Aport" search_bot

SetEnvIfNoCase User-Agent "^msnbot" search_bot

SetEnvIfNoCase User-Agent "^spider" search_bot

SetEnvIfNoCase User-Agent "^Robot" search_bot

SetEnvIfNoCase User-Agent "^php" search_bot

SetEnvIfNoCase User-Agent "^Mail" search_bot

SetEnvIfNoCase User-Agent "^bot" search_bot

SetEnvIfNoCase User-Agent "^igdeSpyder" search_bot

SetEnvIfNoCase User-Agent "^Snapbot" search_bot

SetEnvIfNoCase User-Agent "^WordPress" search_bot

SetEnvIfNoCase User-Agent "^BlogPulseLive" search_bot

SetEnvIfNoCase User-Agent "^Parser" search_botКак можно понять из команды. Каждая строчка содержит в себе запрет индексации для определенного поискового робота.

Если вы хотите запретить, только Яндекс и Google, то пропишите так:

SetEnvIfNoCase User-Agent "^Googlebot" search_bot

SetEnvIfNoCase User-Agent "^Yandex" search_bot5. С помощью HTTP заголовка X-Robots-Tag

Это тоже своего рода настройка сервера с помощью файла .htaccess, но этот способ работает на уровне заголовков. Это один из самых авторитетных способов закрытия сайта от индексации, потому что он настраивается на уровне сервера.

Этот серьезный способ подразумевал под собой отдельную статью, потому что там очень много нюансов. В ней я подробно рассказал, как настроить X-Robots-Tag и использовать для закрытия индексации.

Выводы

Вне зависимости от того, по какой причине вы хотите закрыть сайт, отдельные его страницы или материалы от индексации, можете воспользоваться любым из перечисленных способов. Они простые в реализации, и на их настройку не потребуется много времени. Вы самостоятельно сможете скрыть нужную информацию от роботов, однако стоит учесть, что не все методы помогут на 100%.

Самый просто и в тоже время не всегда исполняемый для поисковых систем метод — это использовать инструкции в файле robots.txt. Meta robots и X-robots-Tag более надежные способы, чтобы запретить индексацию поисковых систем на странице.

Вопросы и ответы про закрытие сайта от индексации

Кратко отвечаю на самые популярные вопросы, которые мне задают на консультациях по поводу закрытия страниц и сайта для индексации.